Et si on hackait l'intelligence artificielle ?

Rédigé par Régis Chatellier

-

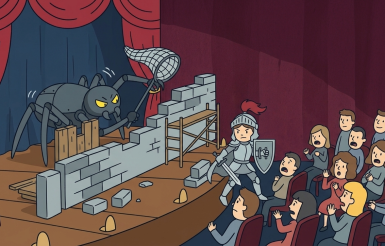

20 décembre 2016L'IA est plus artificielle que réellement intelligente, la raison pour laquelle elle est si vulnérable.

Dans un article du MIT Technology Review, le journaliste Will Knight s'inquiète de l'intérêt que pourrait susciter les systèmes d'intelligence artificielle pour les hackers, qui ne tarderont pas selon lui à tenter de tromper ces dispositifs. Des chercheurs ont démontré que les algorithmes de machine-learning peuvent être manipulés en exploitant leur propension à cibler des modèles (patterns) dans les données : en leur envoyant de fausses informations, les algorithmes construisent des modèles érronés. Il est par exemple possible de tromper un véhicule autonome avec des panneaux d'affichages, ou des assistants à reconnaissance vocale par des signaux inaudibles pour l'oreille humaine. L'algorithme n'est pas encore suffisamment intelligent pour repérer que l'on cherche à le tromper.

Pour Patrick McDaniel, professeur à l'université de Pennsylvanie, "le risque est réel [...] les systèmes de machine-learning opèrent sur tous types de fonctions pour lesquels des personnes pourraient financer des attaques".

“Almost anything bad you can think of doing to a machine-learning model can be done right now [...] And defending is really, really hard.”